科學家解釋說,是因為AI在數百萬視頻中找到同一類人群相似的外形特徵。比如非裔女性常是高挑眉,老年人永遠頭髮稀疏,印裔男子喜歡留鬍子,非洲男性戴頂小帽子。

在性別、種族特徵符合後,這些邊緣的外貌特徵也會被畫出來。

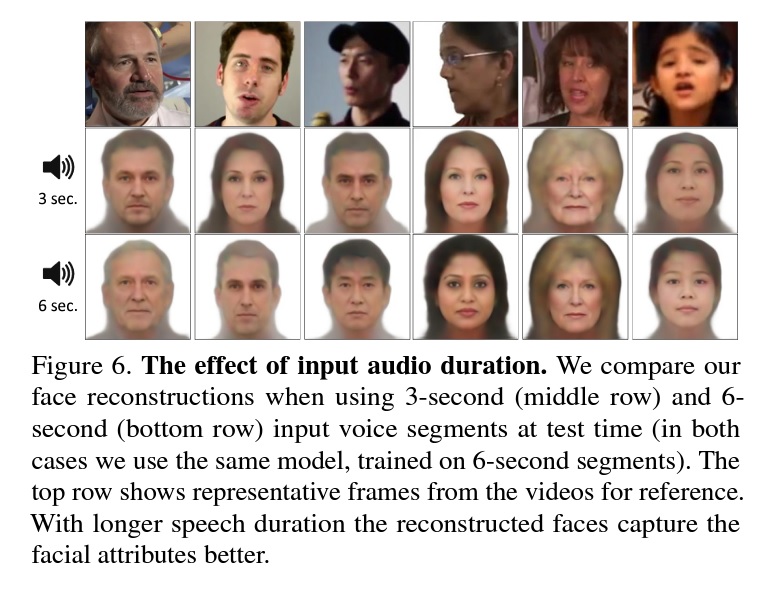

科學家們發現輸入的音頻越長,AI繪製的圖越準確。下圖可以看出,六秒音頻的結果明顯比三秒要好,其中有三個改對了性別、種族和年齡。

如果把一個人的不同視頻片段截出來,會發現它們和AI繪製的圖更像。

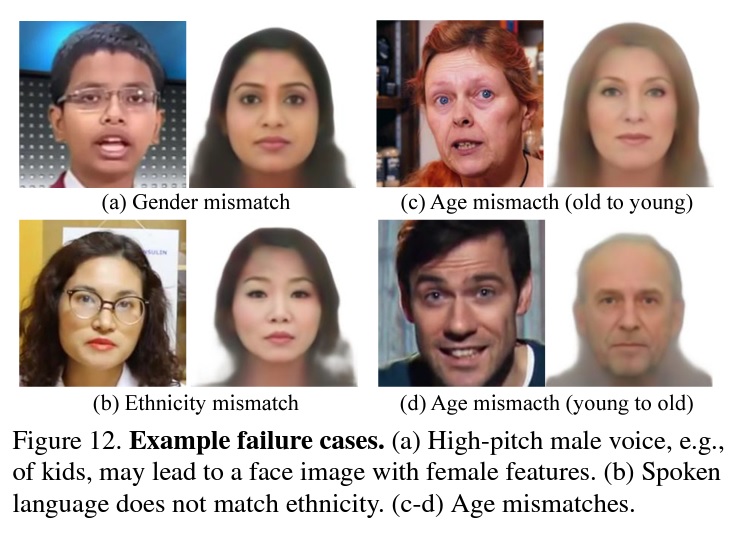

當然,Speech2Face也有翻車的時候,它有時會把音調高的男人當作女人,把聲音嘶啞的男人當作老頭。

種族也會搞錯(雖然長得仍然挺像)。

科學家說這更多表現出的是一種刻板印象,AI能找到的是符合大部分人群的特徵。

「我們使用的訓練數據來自油管上的教育視頻合集,不能代表全世界的人。」他們在論文裡寫道,「因此,就像其他機器學習模型一樣,我們的模型也受到數據分布不均的影響。」

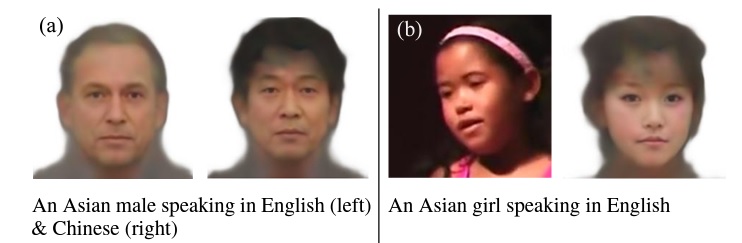

這種刻板印象也和語言有關,當亞裔男性說英語時,Speech2Face以為他是白人男性,當他說中文時,種族又對了。

不過,亞裔女孩說英語時,結果不受語言影響,只是年齡大了些。

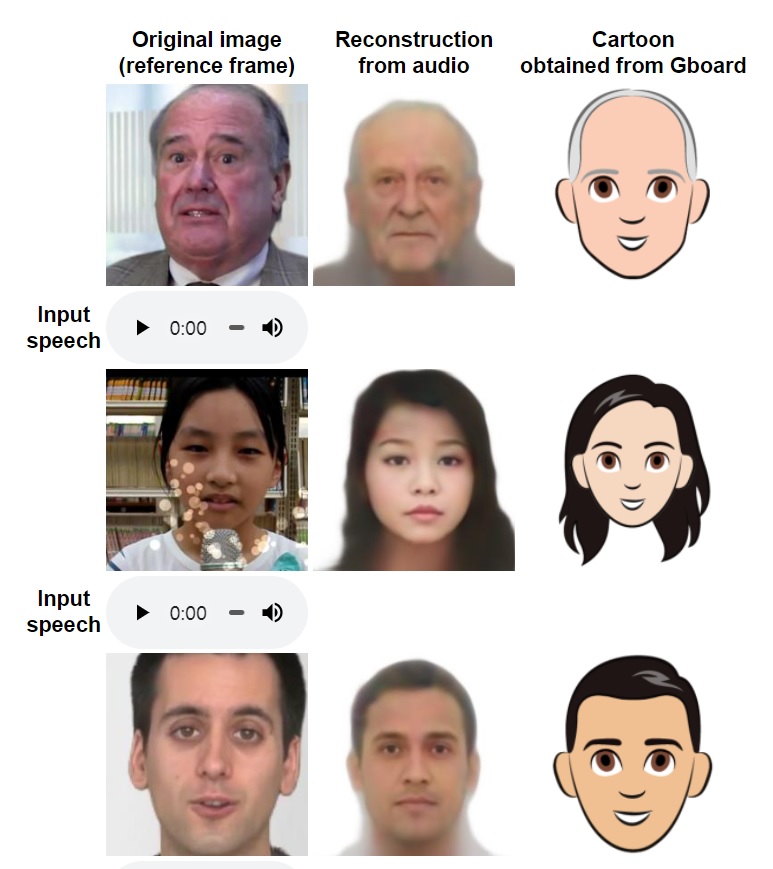

麻省理工的科學家們還做了一個「卡通轉換系統」,讓Speech2Face聽到音頻後繪製出說話者的卡通圖,準確率也挺高的。

這個項目挺有意思,但很多網友表示擔憂:

「那些不願露臉的油管博主現在肯定在瑟瑟發抖。」

「想想看,這技術很容易在網絡社區里被當作武器使,雖然大家都不露面。」

科學家們在論文裡也提到了隱私,他們認為不用擔心。

「我們的方法不能從聲音中復原一個人的真實身份(即他們臉部的確切圖像),因為我們的模型是捕捉多人共有的視覺特徵,只能生產大眾化的平庸面孔,不能製作特定長相。我們的AI圖像不能反映出真人的實際相貌。」

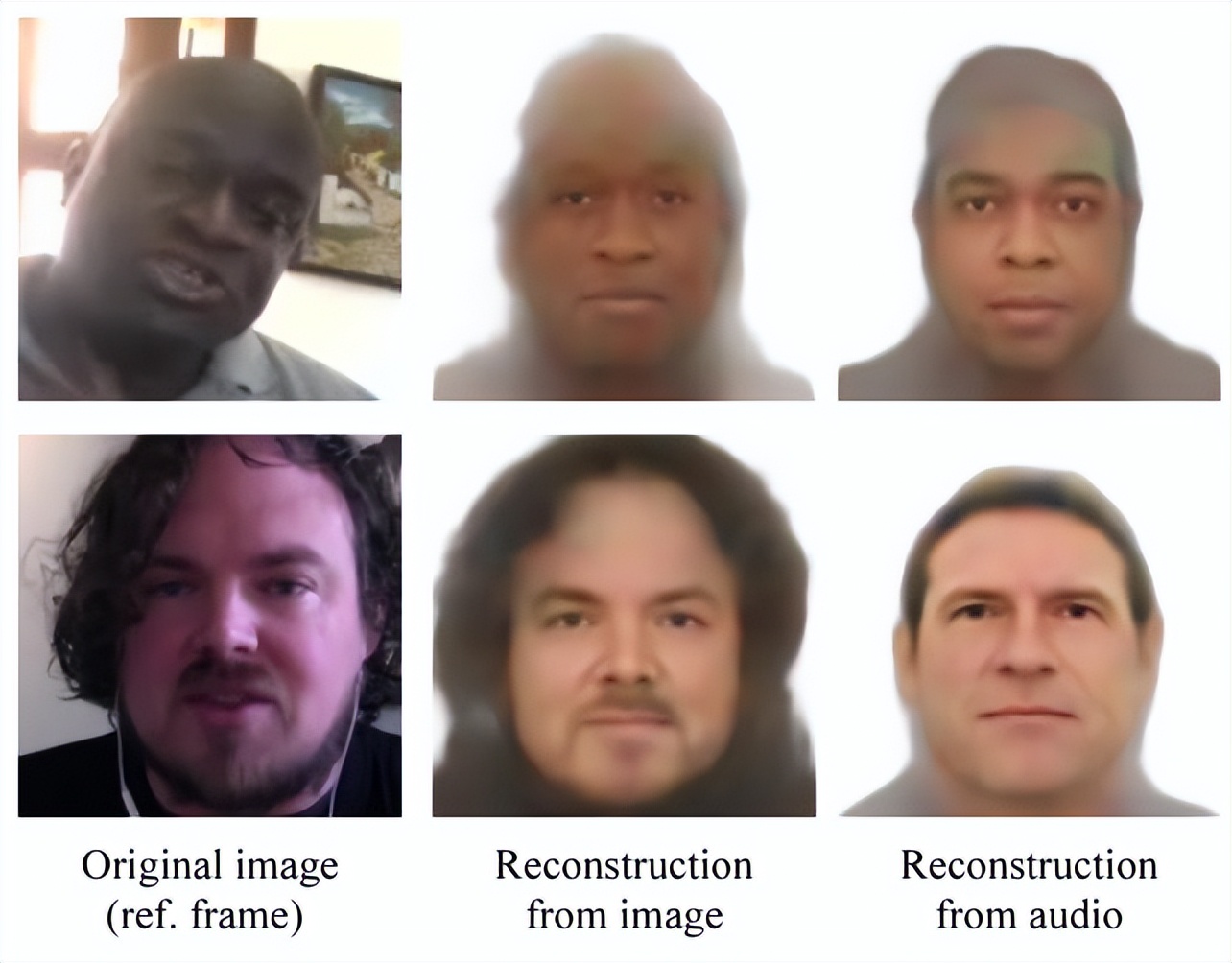

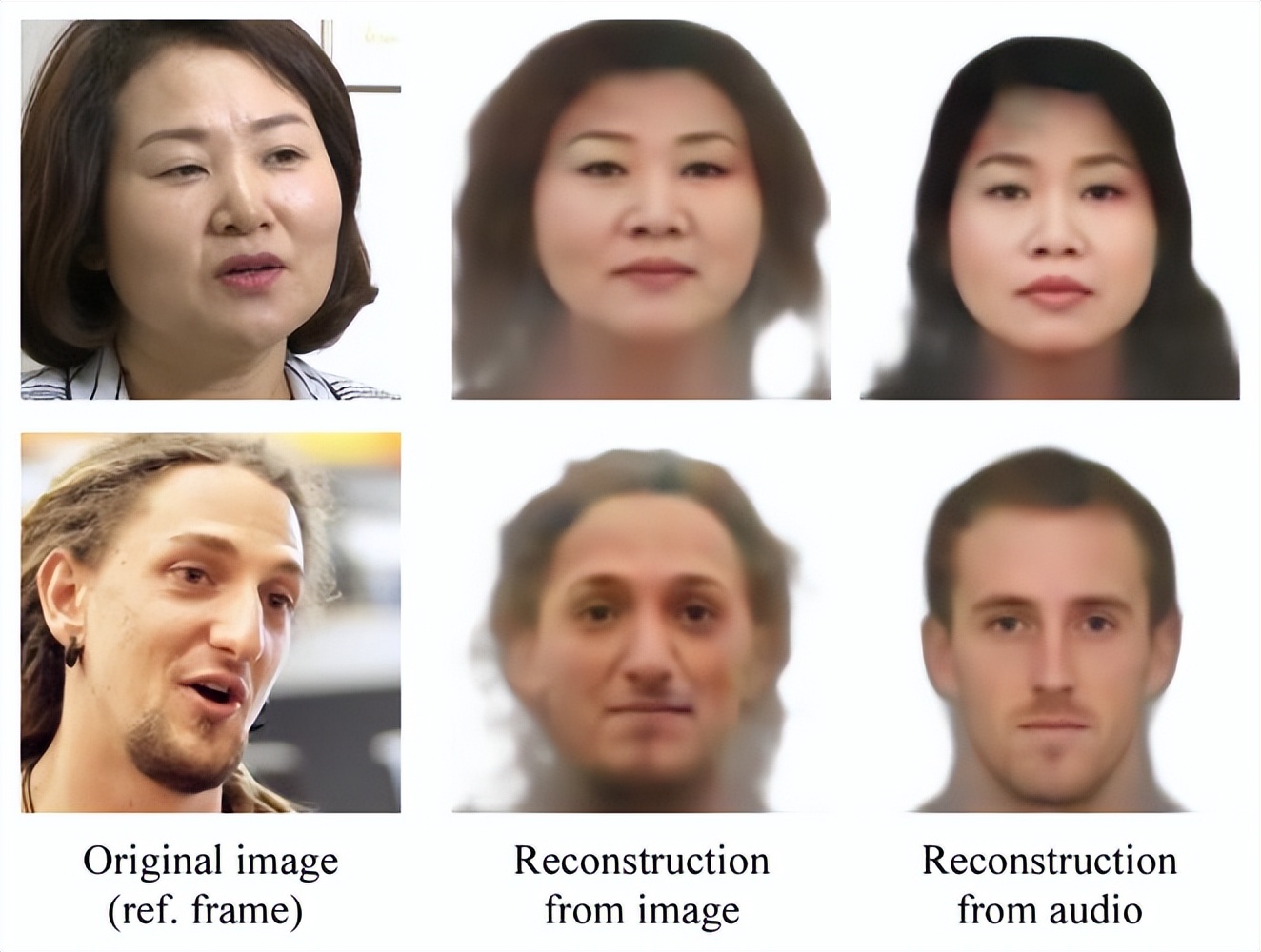

話是這麼說,可從對比圖上看,AI的結果已經很接近真人照了。

如果某些狂熱粉絲想要找到不露面的視頻博主,他們可以輕鬆知道博主的大概樣子,加上地理位置等信息,也許他們能找上門。

想想還是蠻嚇人的,不過類似的AI就算麻省理工不做,其他學校也在做了。

過去幾年,愛爾蘭、西班牙、日本和美國都在研究如何用音頻構建人臉,其中走得最遠的是卡內基梅隆大學的麗塔·辛格(Rita Singh)。

有好事者在2014年反覆向美國海岸警衛隊報假警,每通電話非常短。海岸警衛隊找到研究語音識別20年的麗塔,問她有什麼辦法。

她先是比較了人耳無法察覺的發音上的特徵,然後把報警電話分割為幾毫秒的小片段,用AI梳理它們尋找信息點。

靠著微弱的信息,麗塔不光能知道報假警的人大致長什麼樣,還能知道他所處的環境,比如房間的大小,是否有窗戶,以及牆壁用什麼材料製成。

她的AI甚至能檢測到錄音中,因為當地電網波動產生的雜音。她將雜音和電網資料庫匹配,可以知道報警者實際的位置,還有掛電話的確切時間。

最後,麗塔不僅解決了惡作劇電話,還解決了兒童性騷擾案件。

那些只露聲不露臉的罪犯,自己把自己出賣了。

AI技術就是一把雙刃劍,它可以逮捕罪犯,也可以傷害無辜者。

用聲音繪製人臉,這個技術看來是無法避免的,只能希望它以後都用在正道上吧……